Inizialmente infatti questa serie 3000 mi ha incuriosito non poco, perchè prometteva un notevole salto in avanti con dei buoni prezzi. Adesso mi sto rendendo conto però che una 3060 fatica con i giochi 1080p60 (tipo Cyberpunk), proprio come faticava la 2060 con i titoli di quel tempo e la 1060 ancora prima. Diciamo che i prezzi sono rimasti gli stessi (un po’ più accessibili, ma quando ci saranno effettivamente le schede disponibili), le risoluzioni e frame rate pure, cambiano solo giochi che essendo più pesanti girano esattamente come prima. Poi è ovvio che se si usa come benchmark The Witcher 3 (comunque un gioco pesante dell’epoca) si ottengono risultati migliori.e allora come avevo intuito è quello il problema più grande... ti manca proprio l'aver vissuto il grosso salto in avanti da una generazione che puntava a maxare il 1440p a 60fps per i titoli più pesanti e si affacciava timidamente al 4k nel migliore dei casi ad una che di fatto ha imposto il 4k/60fps come target raggiungibile, ecco perchè il salto di qualità da 20xx a 30xx per me non è paragonabile a quello precedente. La 30xx migliora quel che si era visto nelle 20xx ma grossomodo si porta dietro gli stessi limiti (non tutti imputabili all'hardware) perchè nvidia ha adoperato precise scelte di mercato... tu mi parli di +20-30% etc... ma all'atto pratico dove li collochi? su un WDL che in 4k su una 2080ti crolla a 42fps e su una 3080 a fatica sta a 50fps?o su un qualsiasi AAA pesante che con la 2080ti in 4k stava a >60 e con la 3080 a >70? per ottenere quale plus di preciso? dato che sono cmq prestazioni lontane a dover giustificare l'acquisto di un costoso monitor 4k da 100hz o in su.

Aspettiamo quest'anno o forse l'anno prossimo per vedere se uscirà un gioco che fungerà da "control" della 3080/3080ti o 30xx in generale

Installa l'app

Come installare l'app su iOS

Segui il video qui sotto per vedere come installare il nostro sito come web app sulla tua schermata principale.

Nota: Questa funzionalità potrebbe non essere disponibile in alcuni browser.

Pubblicità

Stai usando un browser non aggiornato. Potresti non visualizzare correttamente questo o altri siti web.

Dovreste aggiornare o usare un browser alternativo.

Dovreste aggiornare o usare un browser alternativo.

Schede Video | Guida in prima pagina

- Autore discussione Matteus

- Data d'inizio

Pubblicità

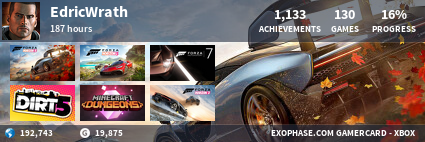

EdricWrath

Random Guy (Maybe) - AKA Deme80car (Cambiato Nick)

Offline

Se ha la fattura e ha già pagato è fatta, non possono chiedergli altri soldi, devono dargli ciò che ha comprato. Se i loro fornitori hanno alzato il prezzo dopo che loro hanno continuato a vendere con il magazzino vuoto è solo colpa loro. Digli di insistere e/o minacciare di contattare le autorità. Sta cosa non sta né in cielo né in terra. Che gentaglia.Mi ha detto che ha la fattura.

Più tardi glielo richiedo

akkakappa909

Apprendista

- Iscritto dal

- 15 Giu 2016

- Messaggi

- 830

- Reazioni

- 126

Offline

unica soluzione fargli scrivere una pec direttamente dall'avvocato. A quel punto se non sono scemi la evadono al prezzo cui l'aveva pagataUn mio amico ha preordinato la 3080 tuf su drako mesi fa, pagata 739€, oggi gli arriva questa mail:

Ti scrivo per aggiornarti sul tuo ordine: la GPU è arrivata, e siamo pronti per l'evasione, il problema è che il prodotto prenotato ha subito un incremento di prezzo esponenziale, e non possiamo mantenere il prezzo inizialmente indicato a catalogo. Il nuovo prezzo di vendita è di 999€, ma per chi ha prenotato mesi fà stiamo limitando l'aumento a 949€. Ci serve avere una conferma del nuovo prezzo entro le prossime 24 ore, trascorse le quali, non ricevendo aggiornamenti da parte tua, procederemo all'annullamento dell'ordine. Grazie.

Ma lo possono fare? 210€ di sovrapprezzo

Emhyr var Emreis

Jǫrmungandr

Offline

L' hanno venduta ad un prezzo, non lo possono alzare successivamente.Un mio amico ha preordinato la 3080 tuf su drako mesi fa, pagata 739€, oggi gli arriva questa mail:

Ti scrivo per aggiornarti sul tuo ordine: la GPU è arrivata, e siamo pronti per l'evasione, il problema è che il prodotto prenotato ha subito un incremento di prezzo esponenziale, e non possiamo mantenere il prezzo inizialmente indicato a catalogo. Il nuovo prezzo di vendita è di 999€, ma per chi ha prenotato mesi fà stiamo limitando l'aumento a 949€. Ci serve avere una conferma del nuovo prezzo entro le prossime 24 ore, trascorse le quali, non ricevendo aggiornamenti da parte tua, procederemo all'annullamento dell'ordine. Grazie.

Ma lo possono fare? 210€ di sovrapprezzo

Il tuo amico ha già acquistato il prodotto, perciò non deve pagare in più perchè per il negozio c'è stato un aumento dei costi.

Son cazzi loro.

Ma scherziamo?

Che miserabili.

Ci sono associazioni dei consumatori che danno assistenza in sti casi mi sa

stiiiv

Master of forum

- Iscritto dal

- 24 Gen 2010

- Messaggi

- 11,873

- Reazioni

- 838

Offline

Ma l'ha effettivamente pagata, oppure presa solo in prenotazione senza versare 1€? Nel primo caso, non penso possano chiedere la differenza, nel secondo invece sì visto che asus stessa ha alzato i prezzi. Senza difenderli sia chiaro visto che ha comunque prezzi assurdi, però son 2 robe diverse.

La tuf invece è apparsa a 890 su quello ita.

Post automatically merged:

Ti conviene tenere d'occhio gli alert se riesci. Banalmente ora con 990 ti compri la ROG su amazon.it quando è disponibile ovviamente. Ok se non vuoi spendere certe cifre ci sta, però giusto per fare un confronto, a sto punto spendere 990€ da drako per una TUF, e spenderne 990 su amazon.it per una ROG, scelgo la seconda.Ah beh a sto punto disdico la mia visto che pure io ho fatto il preorder su drako. Ciao ciao.

La tuf invece è apparsa a 890 su quello ita.

Ultima modifica:

- Iscritto dal

- 23 Ago 2020

- Messaggi

- 667

- Reazioni

- 217

Offline

Ciao. Allora, per curiosità sono andato a vedermi il contratto di vendita dal sito della drako e c'è questa clausola:Un mio amico ha preordinato la 3080 tuf su drako mesi fa, pagata 739€, oggi gli arriva questa mail:

Ti scrivo per aggiornarti sul tuo ordine: la GPU è arrivata, e siamo pronti per l'evasione, il problema è che il prodotto prenotato ha subito un incremento di prezzo esponenziale, e non possiamo mantenere il prezzo inizialmente indicato a catalogo. Il nuovo prezzo di vendita è di 999€, ma per chi ha prenotato mesi fà stiamo limitando l'aumento a 949€. Ci serve avere una conferma del nuovo prezzo entro le prossime 24 ore, trascorse le quali, non ricevendo aggiornamenti da parte tua, procederemo all'annullamento dell'ordine. Grazie.

Ma lo possono fare? 210€ di sovrapprezzo

blablablavivogliamofregareblablabla

Qualora, a causa di disguidi o altri inconvenienti, il prezzo indicato nel sito dovesse risultare diverso dal prezzo corretto di vendita di un prodotto, potremo contattarti per verificare se desideri egualmente acquistare il prodotto al prezzo corretto oppure potremo non accettare il tuo ordine. Qualora il prezzo corretto di un prodotto sia inferiore a quello indicato nel sito, ti addebiteremo il solo prezzo corretto inferiore e ti spediremo comunque il prodotto.

In teoria lo possono fare (anche se eticamente è 'discutibile')..in teoria, ma qui sono passati mesi. Io direi al tuo amico di rivolgermi a qualche associazione per la tutela dei consumatori e sentire cosa dicono gente del mestiere.

moon knight

Divinità

- Iscritto dal

- 13 Set 2009

- Messaggi

- 17,920

- Reazioni

- 1,314

Offline

Qualora, a causa di disguidi o altri inconvenienti, il prezzo indicato nel sito dovesse risultare diverso dal prezzo corretto di vendita di un prodotto

Si, ma non è la stessa cosa, qui parla di glitch del sito o errori umani per cui il prezzo di listino può risultare inferiore a quello corretto di vendita, un pò come quando trovavi i prezzi scontatissimi dei giochi su Steam per un bug, che poi veniva corretto.

Non è il caso qui, perchè non si tratta di un disguido o di un inconveniente. Hanno venduto il prodotto ad un prezzo e dopo pochi mesi pensano che quel prezzo si troppo basso e vogliono aumentarlo.

- Iscritto dal

- 23 Ago 2020

- Messaggi

- 667

- Reazioni

- 217

Offline

Si può interpretare. La cosa non convince nemmeno me ma se vogliono attaccarsi a qualcosa potrebbero farlo con questo, non mi sembra di aver letto nient'altro che possa giustificare il coraggio di chiamare un cliente per 'ritoccare' il prezzo dopo mesi di attesa.Si, ma non è la stessa cosa, qui parla di glitch del sito o errori umani per cui il prezzo di listino può risultare inferiore a quello corretto di vendita, un pò come quando trovavi i prezzi scontatissimi dei giochi su Steam per un bug, che poi veniva corretto.

Non è il caso qui, perchè non si tratta di un disguido o di un inconveniente. Hanno venduto il prodotto ad un prezzo e dopo pochi mesi pensano che quel prezzo si troppo basso e vogliono aumentarlo.

stiiiv

Master of forum

- Iscritto dal

- 24 Gen 2010

- Messaggi

- 11,873

- Reazioni

- 838

Offline

Ma sei sicuro che l'hanno venduto? Cioè quelli che han ricevuto la mail, HANNO PAGATO? Se no è come prendere il bigliettino per fare la coda e bon. Su pchunter paghi in anticipo e quindi la prenotazione avviene così. Su drako da quanto ne so, nessuno di quelli che hanno prenotato hanno pagato qualcosa in anticipo, semplicemente appunto si prenotavano.Si, ma non è la stessa cosa, qui parla di glitch del sito o errori umani per cui il prezzo di listino può risultare inferiore a quello corretto di vendita, un pò come quando trovavi i prezzi scontatissimi dei giochi su Steam per un bug, che poi veniva corretto.

Non è il caso qui, perchè non si tratta di un disguido o di un inconveniente. Hanno venduto il prodotto ad un prezzo e dopo pochi mesi pensano che quel prezzo si troppo basso e vogliono aumentarlo.

moon knight

Divinità

- Iscritto dal

- 13 Set 2009

- Messaggi

- 17,920

- Reazioni

- 1,314

Offline

Ma sei sicuro che l'hanno venduto?

Il preordine è un acquisto vero e proprio dal punto di vista legale, credo.

Su drako da quanto ne so, nessuno di quelli che hanno prenotato hanno pagato qualcosa in anticipo, semplicemente appunto si prenotavano.

Quindi era una coda, non un preordine?

stiiiv

Master of forum

- Iscritto dal

- 24 Gen 2010

- Messaggi

- 11,873

- Reazioni

- 838

Offline

Mi pare, poi potrei sbagliarmi. Ora non so come lo chiamavano, ma il succo è che se non sbaglio, non hanno preso soldi in anticipo. Penso che nessuno shop l'abbia fatto per evitare poi cazzi di questo tipo. Schede che aumentano di prezzo perché la casa produttrice stessa aumenta i prezzi, e quindi via di rimborsi ecc ecc.Il preordine è un acquisto vero e proprio dal punto di vista legale, credo.

Quindi era una coda, non un preordine?

Ultima modifica:

EdricWrath

Random Guy (Maybe) - AKA Deme80car (Cambiato Nick)

Offline

Per questo chiedevo se ha la fattura in mano, se ce l'ha e ha già pagato Drako si può attaccare solo al suo c@zzo perché non c'è clausola che tenga. Sul loro sito possono anche scrivere che possono toglierti la madre ma in Italia è comunque illegale quindi...

Basta scrivergli che stai aspettando la scheda per cui hai pagato (e hai già ricevuto la fattura), che non accetti l'aumento di prezzo e minacci di chiamare la finanza.

Basta scrivergli che stai aspettando la scheda per cui hai pagato (e hai già ricevuto la fattura), che non accetti l'aumento di prezzo e minacci di chiamare la finanza.

.Veg

Master of forum

- Iscritto dal

- 20 Set 2011

- Messaggi

- 4,808

- Reazioni

- 1,057

Offline

Sarò anche arrivato ad associare le targhe d auto FE alle Founder Edition nel periodo in cui ero infognato col canale telegram e discord, ma al momento sto ringraziando il me del passato.

Come si fa a far pagare il posto in coda!? Poi il rincaro sul preordine, il negoziante non fa degli accordi con il suo fornitore? Anzi, forse è proprio questo il punto, preordini accettati senza base di stock dietro col fornitore, ma in ogni caso non è affare del cliente.

Come si fa a far pagare il posto in coda!? Poi il rincaro sul preordine, il negoziante non fa degli accordi con il suo fornitore? Anzi, forse è proprio questo il punto, preordini accettati senza base di stock dietro col fornitore, ma in ogni caso non è affare del cliente.

Lusian

Novizio

Offline

è veramente ridicolo . So che a non aver aggiornato/comprato la nuova SV alla fine ci perdo io , ma allo stato attuale non faccio code non do soldi in anticipo senza sapere quando riceverò cosa , non pago 400 euro di piu per avere quella che voglio ...ma che se ne andassero a fan %£$%£$% ..un po tutti , rivenditori , nvidia, Scalper ecc..ecc.

stiiiv

Master of forum

- Iscritto dal

- 24 Gen 2010

- Messaggi

- 11,873

- Reazioni

- 838

Offline

Sarò anche arrivato ad associare le targhe d auto FE alle Founder Edition nel periodo in cui ero infognato col canale telegram e discord, ma al momento sto ringraziando il me del passato.

Come si fa a far pagare il posto in coda!? Poi il rincaro sul preordine, il negoziante non fa degli accordi con il suo fornitore? Anzi, forse è proprio questo il punto, preordini accettati senza base di stock dietro col fornitore, ma in ogni caso non è affare del cliente.

caro amico, mi sa che di sto passo farò la tua fine con la non ricordo che scheda avevi prima ma ricordo che era vecchissima

caro amico, mi sa che di sto passo farò la tua fine con la non ricordo che scheda avevi prima ma ricordo che era vecchissima

Davvero, salvo "bombe" di 3070 serie a 580-600 massimo massimo, di sto passo mi tengo la 1060 finché campa e cambio alla serie 40

Stamattina c'è stata la zotac a 557 sull'amazon francese, qua da noi 599.

Stamattina c'è stata la zotac a 557 sull'amazon francese, qua da noi 599.  No grazie.

No grazie.Anzi in realtà ci stavo pensando di nuovo su, e non mi dispiacerebbe neanche prendere una 3060ti a 450 massimo. Tanto alla fine quando sarà da cambiare la 3060ti sarà da cambiare pure la 3070 bene o male. Ok va un 10-12% in più ma nulla di sconvolgente.

- Iscritto dal

- 4 Mar 2003

- Messaggi

- 3,406

- Reazioni

- 95

Offline

caro amico, mi sa che di sto passo farò la tua fine con la non ricordo che scheda avevi prima ma ricordo che era vecchissima

Davvero, salvo "bombe" di 3070 serie a 580-600 massimo massimo, di sto passo mi tengo la 1060 finché campa e cambio alla serie 40Stamattina c'è stata la zotac a 557 sull'amazon francese, qua da noi 599.

No grazie.

Anzi in realtà ci stavo pensando di nuovo su, e non mi dispiacerebbe neanche prendere una 3060ti a 450 massimo. Tanto alla fine quando sarà da cambiare la 3060ti sarà da cambiare pure la 3070 bene o male. Ok va un 10-12% in più ma nulla di sconvolgente.

la 3060ti è uscita qualche giorno fa sull'amazon francese a 453 euro

che poi non capisco come mai fino a qualche settimana fa costava tutto di meno sull'amazon italiano rispetto gli altri e ora pare di no lol

che poi non capisco come mai fino a qualche settimana fa costava tutto di meno sull'amazon italiano rispetto gli altri e ora pare di no lolquando io ho preso la mia tuf 3080 a 899 su amazon.it la si trovava a 950+ sugli altri amazon

- Iscritto dal

- 23 Ago 2020

- Messaggi

- 667

- Reazioni

- 217

Offline

E che è..il pizzo? Ma stiamo scherzando?50€ per mantenere il posto in coda. Lol. Tra l'altro senza sapere quando arriverà e a che prezzo. 50€ che verranno scalati immagino, VERO??

Dovrebbero darli loro a me quei 50 euro per rimanere in coda per mesi, il mio (e il vostro) tempo è prezioso. Se devo aspettare, per poi essere perculato cosi, tanto vale che aspetto la disponibilità su amazon.

Pubblicità

Condividi:

Pubblicità